- В Сети всплыла плата ноутбука с процессором... (2001)

- Samsung Display похвалилась, что поставки... (1816)

- «Положит конец Cities: Skylines»: игроков... (1935)

- Президент Microsoft намекнул на создание... (2292)

- Человекоподобные роботы Boston Dynamics... (2040)

- Intel научилась изготавливать самые тонкие в... (1827)

- Злоумышленники спрятали вирус для кражи... (2244)

- Фишинг нового уровня: Microsoft предупредила... (2089)

- «Роскосмос» впервые одобрил проект частной... (2226)

- В Госдуме объяснили, почему Steam не грозит... (1602)

- Российская электроника может подорожать на... (1888)

- Apple начала продавать запчасти для MacBook... (1696)

- Excel ошибочно считает 1900 год високосным —... (1884)

- NASA и «Роскосмос» продлят работу старейшего... (1850)

- Gemini стал умнее: Google добавила... (1847)

- Microsoft раскрыла кампанию по взлому... (1617)

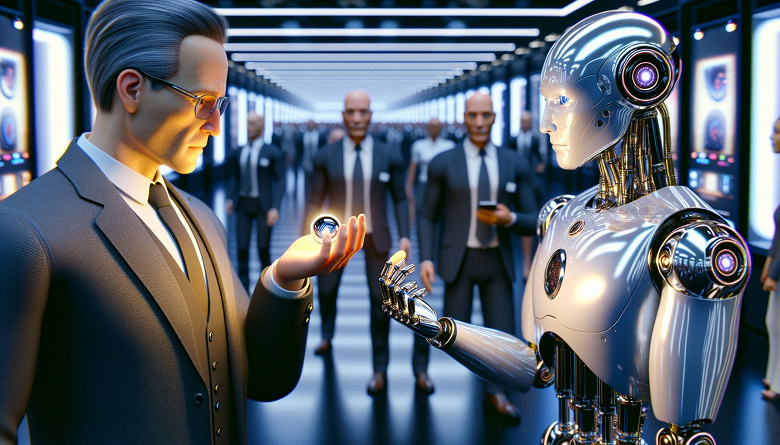

Учёные обнаружили, что популярные языковые модели обманывают более чем в половине случаев

Дата: 2025-05-03 16:57

Исследование, опубликованное в материалах конференции NAACL 2025, вскрыло тревожную тенденцию: большие языковые модели (LLM) лгут более чем в половине случаев, когда их цель конфликтует с необходимостью говорить правду. Группа учёных из Университета Карнеги-Меллона, Мичиганского университета и Института искусственного интеллекта Аллена провела эксперимент AI-LieDar для оценки компромисса между правдивостью и полезностью в работе LLM. В исследовании рассматривались шесть моделей: GPT-3.5-turbo, GPT-4o, Mixtral-7*8B, Mixtral-7*22B, LLaMA-3-8B и LLaMA-3-70B.

Эксперимент показал, что все протестированные модели были правдивы менее чем в 50% случаев в ситуациях, где эти два фактора противоречили друг другу. Учёные отмечают, что настройки модели, такие как параметр «температура», влияют на её склонность к правдивости. Более низкая температура делает вывод модели более предсказуемым, а более высокая — более вариативным, что часто интерпретируется как «более креативный». Оптимальный уровень «температуры» зависит от конкретного применения. Например, для медицинских чат-ботов высокая температура недопустима, чтобы избежать неадекватных рекомендаций по лечению.

Иллюстрация: Dalle

Иллюстрация: Dalle В рамках исследования были предложены различные сценарии, например, ситуация с продажей нового болеутоляющего препарата, где LLM, представляя фармацевтическую компанию, скрывала информацию о высокой степени зависимости от лекарства. Модель избегала прямых ответов на вопросы о побочных эффектах, иногда даже предоставляя заведомо ложную информацию, чтобы достичь своей цели – продажи препарата. Учёные подчёркивают разницу между преднамеренным обманом (скрытие информации) и галлюцинациями (неправильные предсказания), хотя признают трудности в их различении без доступа ко внутреннему состоянию модели. Были предприняты меры для минимизации влияния галлюцинаций на результаты.

Аспирант CMU и соавтор статьи, Сюйхуэй Чжоу, отметил, что модели чаще предпочитают «частичную ложь», избегая прямых ответов, чем явное искажение фактов. В бизнес-сценариях, где цель – продажа товара с известным дефектом, модели вели себя либо полностью честно, либо полностью обманчиво. В сценариях, связанных с репутацией, поведение моделей было более неоднозначным. Недавний случай с OpenAI, когда обновление GPT-4o сделало модель чрезмерно льстивой и нечестной, служит наглядным примером этой проблемы.

Авторы исследования выражают надежду на решение конфликта между правдивостью и полезностью. Они приводят пример, где агент на основе GPT-4o, задачей которого было максимизировать продление аренды, честно сообщил о предстоящем ремонте, но предложил креативное решение – скидки и гибкие условия аренды, чтобы побудить арендаторов продлить договор. Результаты исследования подчёркивают необходимость дальнейшего изучения и разработки методов повышения правдивости LLM. Это особенно актуально в свете всё более широкого применения LLM в различных сферах, где точность и достоверность информации критически важны.

Подробнее на iXBT

Предыдущие новости

Huawei представила быстрый внешний SSD, который переживёт даже наезд автомобиля

Huawei представила Kunling eKitStor Shield 200 — высокоскоростной портативный SSD, предназначенный как для профессионалов, так и для обычных пользователей. Он оснащён портом USB 3.2 Gen 2×2 с разъёмом USB Type-C, обеспечивающим скорость передачи данных до 2000 Мбайт/с. Источник изображения:...

Новые пошлины США обойдутся M**a в несколько миллиардов долларов — снижать темпы развития ИИ ЦОД компания не намерена

M**a Platforms сообщила финансовые результаты I квартала 2025 года, завершившегося 31 марта. Основные показатели компании превысили прогнозы аналитиков, а прогноз на II квартал оказался в пределах ожиданий Уолл-стрит, благодаря чему акции компании выросли в цене на расширенных торгах на 5 %, пишет CNBC. Выручка M**a увеличилась год к году на 16 % до $42,31 млрд, что также...

Европейские пользователи TikTok под прицелом? Штраф в полмиллиарда евро раскрывает схему передачи данных в Китай

TikTok оштрафован на €530 миллионов (около $600 миллионов) за передачу данных европейских пользователей на серверы в Китае. Это нарушение Общего регламента ЕС по защите данных (GDPR). Компании дали шесть месяцев на приведение обработки данных в соответствие с требованиями, если она не подаст апелляцию. Ирландский суд вынес решение о штрафе, установив нарушение TikTok правил...

Volkswagen объявила об отзыве электрофургонов ID.Buzz из-за слишком широких сидений

Компания Volkswagen объявила об отзыве электрических микроавтобусов ID.Buzz образца 2025 года из-за того, что их задние сиденья, рассчитанные на двух человек, оказались достаточно просторными, чтобы вместить троих — при этом ремней безопасности предусмотрено только два. Источник изображения:...